機器人和自動系統的功能正在不斷發展。 人工智能(AI)和機器學習的發展正在推動機器人能力的擴展,將自動化的廣度和深度擴展到其他經濟部門,從製造業,農業到醫療保健和運輸。

隨著自治系統滲透到工作和社會中,他們越來越多地被安排在過去由人類執行的決策職責中。 這些可能包括生死攸關的場景,如軍用無人機,具有何時觸發扳機的自動權限; 自動駕駛汽車必須選擇拯救他們的乘員或衝入道路的行人; 和機器人外科醫生在精確神經外科中自主選擇切口位置。

隨著機器人越來越多地承擔以前受人類判斷支配的情況的責任,必須考慮相關的道德含義。這些考慮因素應包括從多個角度審視道德問題,包括機器人開發人員(如何開發符合道德規範的機器人),操作員(如何以道德方式控制機器人)以及機器本身(如何確保機器人以道德正確性行事) 。

道德問題

幸運的是,專家們正在全世界範圍內進行大量正在進行的討論和研究,探討與機器人和自治系統相關的道德,法律和社會問題。

英國機器人和自治系統網絡(UK-RAS)在最近發布的白皮書中彙編了該領域的一些主要作品清單。該報告回顧了與機器人技術和自動系統的開發和運行相關的若干道德問題,值得仔細考慮。這些問題包括不透明,疏忽,欺騙,偏見,就業,安全和隱私等問題。

不透明度是指在自治系統的決策過程中需要透明度,以便可以調查決策的公平性。這與疏忽問題有關,這涉及操作員對機器人的監督。為了有效(和道德地)管理機器人行為,操作員必須能夠理解機器人決策背後的推理。

欺騙是與不透明度相關的另一個問題。機器人和自治系統的性質應該是開放和誠實的,以免誤導或利用弱勢用戶。例如,存在這樣的風險:一個人可能在情感上附著在機器人身上而不知道它實際上沒有感覺但是僅被編程為表現得像它一樣。

偏差可能源於有缺陷的算法或不完整的機器學習集。例如,使用僅包含具有特定膚色的人的圖像的數據庫訓練的自動駕駛汽車可能無法識別具有其他膚色的人,從而導致危險情況。

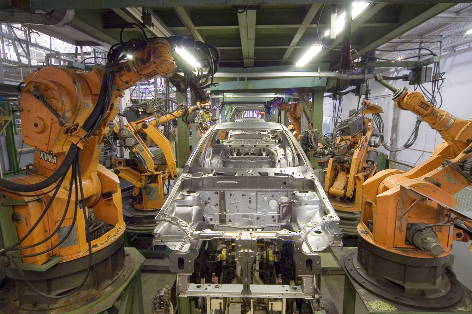

就業是與自治系統相關的另一個問題。在製造業,機器人已經逐漸取代手工勞動數十年。隨著AI不斷改進,機器人將能夠執行更複雜的任務,這些任務目前是人類的專屬領域。這可能會增加就業機會,同時希望開啟新的機會。

安全性也是自治系統的雙面問題。機器人可以消除人為錯誤,使系統更安全。另一方面,機器人也可能因錯誤的算法,有限的訓練集或編程不足而使他們無法處理新情況而犯錯誤。在這些情況下,安全性可能會受到負面影響。

隱私被認為是許多人的權利。可訪問私人數據的機器人和自治系統(例如自動駕駛車輛中的位置跟踪功能提供的系統)應根據道德準則行事以保護該信息。

上面提到的道德問題並非包羅萬象,只適用於當今存在的有限AI技術所支持的基本機器人系統。

由真正的人工智能(AGI)實現的更先進的自治系統將帶來一系列新的倫理問題,其中至少涉及機器意識本質的道德問題。

圖文參考: engineering360